V roce 2015 znamenalo scrapování buď otravovat vývojáře, ať ti napíšou Python skript, nebo obětovat víkend tomu, že se budeš učit XPath. V roce 2026 už jen napíšeš „seber všechny názvy produktů a ceny“ — a AI udělá zbytek.

Ta změna přišla až překvapivě rychle. Web scraping dnes používá už přes . Trh v roce 2024 překonal hranici a do roku 2030 má podle odhadů minimálně zdvojnásobit.

Hlavní motor? AI web crawler. Dokáže se přizpůsobit změnám rozložení stránky. Chápe obsah, ne jen HTML značky. A hlavně: zvládnou ho používat i lidi, kteří nikdy nenapsali ani řádek kódu — přesně to, co dnes znamená webové crawlování v praxi.

Strávil jsem měsíce testováním 15 nástrojů. Tady jsou moje zjištění — včetně toho, proč Thunderbit (ano, firma, kterou jsem spoluzaložil) skončil na prvním místě.

Proč AI mění scrapování webových stránek: nová éra nástrojů typu Web Scraper

Řekněme si to bez obalu: klasický web scraping nikdy nebyl stavěný pro běžné lidi z byznysu. Všechno se točilo kolem kódu, selektorů a věčného doufání, že se skript nerozsype při první změně layoutu. Jenže AI a LLM to celé převrátily vzhůru nohama.

Jak konkrétně?

- Instrukce v přirozeném jazyce: Místo boje s kódem prostě řekneš, co potřebuješ. Nástroje jako pochopí normální zadání a samy nastaví extrakci ().

- Adaptivní učení: AI scrapery se dokážou na webu, takže je potřeba mnohem méně údržby.

- Práce s dynamickým obsahem: Moderní weby jedou na JavaScriptu a nekonečném scrollování. AI nástroje s tím umí pracovat a vytáhnou data, která by staré scrapery klidně minuly.

- Strukturovaný výstup díky AI parsování: Scrapery postavené na LLM opravdu a vrací čistá, strukturovaná data.

- Automatické obcházení anti-bot ochrany: AI scrapery umí a používají proxy/headless prohlížeče, aby se vyhnuly blokacím IP.

- Napojení na datové workflow: Ty nejlepší nástroje data jen „nevytáhnou“ — rovnou je doručí tam, kde je potřebuješ, třeba jedním klikem do Google Sheets, Airtable, Notion a dalších ().

Výsledek? Web scraping je dnes otázka pár kliknutí (nebo konverzace jako v chatu). Díky tomu můžou webová data používat přímo obchodní, marketingové i provozní týmy — ne jen vývojáři.

15 AI webových crawlerů, které stojí za pozornost v roce 2026

Pojďme si projít top 15 AI web crawlerů — začneme Thunderbitem. U každého nástroje shrnu klíčové funkce, pro koho je určený, cenu a čím vyčnívá. A jo, budu upřímný i v tom, kde je který nástroj fakt skvělý (a kde může narazit).

1. Thunderbit: AI Web Scraper pro každého

Jasně, tady jsem trochu zaujatý — ale Thunderbit je AI Web Scraper, který bych si přál mít už před lety. Proč je na prvním místě:

- Extrakce v přirozeném jazyce: S Thunderbitem si prostě „pokecáš“. Popíšeš, co chceš — třeba „vytáhni všechny názvy produktů a ceny z této stránky“ — a AI to zařídí (). Bez kódu, bez selektorů, bez stresu.

- Crawlování podstránek a více úrovní: Thunderbit umí . Typicky: vezmeš seznam produktů a pak automaticky projdeš detail každého produktu — všechno v jednom běhu.

- Okamžitý strukturovaný výstup: AI data , navrhuje relevantní sloupce, sjednocuje formáty a zvládne i shrnovat nebo kategorizovat text.

- Široká podpora zdrojů: Thunderbit není jen na HTML — umí tahat data i z PDF a obrázků díky vestavěnému OCR a vision AI ().

- Integrace pro byznys: Export jedním klikem do Google Sheets, Airtable, Notion nebo Excelu (). Můžeš plánovat scrapování a posílat data rovnou do týmového workflow.

- Předpřipravené šablony: Pro weby jako Amazon, LinkedIn, Zillow atd. nabízí Thunderbit pro extrakci na jedno kliknutí.

- Přívětivý a dostupný: Rozhraní je jednoduché, klikací, s intuitivním asistentem. Podle uživatelů se dá začít během pár minut.

Thunderbit používá přes , včetně týmů v Accenture, Grammarly a Puma. Obchodníci ho využívají pro , realitní makléři agregují nabídky nemovitostí a marketéři sledují konkurenci — bez jediného řádku kódu.

Cena: K dispozici je (až 100 kroků/měsíc), placené tarify začínají na 14,99 USD/měsíc. I vyšší plány jsou cenově dostupné pro jednotlivce a malé týmy.

Thunderbit je to nejbližší, co jsem viděl k „proměně webu v databázi“ — a je postavený pro všechny, ne jen pro inženýry.

2. Crawl4AI

Pro koho: Vývojáři a technické týmy, které staví vlastní pipeline.

Crawl4AI je open-source framework v Pythonu optimalizovaný na rychlost a velkoobjemové crawlování, navržený s ohledem na . Je extrémně rychlý, podporuje headless prohlížeče pro dynamický obsah a umí strukturovat data tak, aby se snadno krmila do AI workflow.

- Nejlepší pro: Vývojáře, kteří chtějí výkonný a přizpůsobitelný crawling engine.

- Cena: Zdarma (MIT licence). Hostování a provoz je na vás.

3. ScrapeGraphAI

Pro koho: Vývojáři a analytici, kteří staví AI agenty nebo složitější datové pipeline.

ScrapeGraphAI je promptově řízená open-source knihovna v Pythonu, která pomocí LLM převádí weby na strukturované datové „grafy“. Můžeš zadat prompt typu „Vytáhni názvy produktů, ceny a hodnocení z prvních 5 stránek“ a nástroj ti sestaví scraping workflow ().

- Nejlepší pro: Technicky zdatné uživatele, kteří chtějí flexibilní scraping přes prompty.

- Cena: Open-source knihovna zdarma; cloud API od 20 USD/měsíc.

4. Firecrawl

Pro koho: Vývojáři, kteří staví AI agenty nebo velké datové pipeline.

Firecrawl je AI-orientovaná crawling platforma a API, které převádí celé weby na data „připravená pro LLM“ (). Vrací Markdown nebo JSON, zvládá dynamický obsah a integruje se s frameworky jako LangChain a LlamaIndex.

- Nejlepší pro: Vývojáře, kteří potřebují posílat živá webová data do AI modelů.

- Cena: Open-source jádro zdarma; cloud plány od 19 USD/měsíc.

5. Browse AI

Pro koho: Byznys uživatelé, growth hackeři a analytici.

Browse AI je no-code platforma s . „Natrénuješ“ robota tím, že naklikáš data, která chceš, a AI pak ten vzor zobecní pro další běhy. Zvládá přihlášení, nekonečný scroll a umí hlídat změny na webu.

- Nejlepší pro: Ne-technické uživatele, kteří chtějí automatizovat sběr dat a monitoring.

- Cena: Free plán (50 kreditů/měsíc); placené plány od 19 USD/měsíc.

6. LLM Scraper

Pro koho: Vývojáři, kteří chtějí nechat parsování na AI.

LLM Scraper je open-source knihovna pro JavaScript/TypeScript, kde si a LLM z libovolné stránky vytáhne data podle něj. Je postavená na Playwrightu, podporuje více poskytovatelů LLM a umí dokonce generovat znovupoužitelný kód.

- Nejlepší pro: Vývojáře, kteří chtějí převádět weby na strukturovaná data pomocí LLM.

- Cena: Zdarma (MIT licence).

7. Reader (Jina Reader)

Pro koho: Vývojáři, kteří staví LLM aplikace, chatboty nebo sumarizátory.

Jina Reader je API, které z webů (a dokonce i z PDF/obrázků) vytáhne a vrátí je jako Markdown nebo JSON připravený pro LLM. Běží na vlastním AI modelu a umí i popisovat obrázky.

- Nejlepší pro: Získání čitelného obsahu pro LLM nebo Q&A systémy.

- Cena: Bezplatné API (pro základní použití není potřeba klíč).

8. Bright Data

Pro koho: Enterprise a profesionální uživatelé, kteří potřebují škálování, compliance a spolehlivost.

Bright Data je těžká váha v oboru webových dat — má obrovskou proxy síť a . Nabízí hotové scrapery, obecné Web Scraper API i datové feedy „připravené pro LLM“.

- Nejlepší pro: Organizace, které potřebují spolehlivá webová data ve velkém.

- Cena: Podle využití, prémiové. K dispozici jsou zkušební verze.

9. Octoparse

Pro koho: Ne-technické až polotechnické publikum.

Octoparse je zavedený no-code nástroj s a AI auto-detekcí. Zvládá přihlášení, nekonečný scroll a export do různých formátů.

- Nejlepší pro: Analytiky, malé firmy nebo výzkumníky.

- Cena: Free verze existuje; placené plány od 119 USD/měsíc.

10. Apify

Pro koho: Vývojáři a technické týmy, které potřebují vlastní scraping/automatizaci.

Apify je cloudová platforma pro běh scraping skriptů („actors“) a nabízí . Je škálovatelná, umí integrace s AI a podporuje správu proxy.

- Nejlepší pro: Vývojáře, kteří chtějí provozovat vlastní skripty v cloudu.

- Cena: Free tier; placené tarify podle využití od 49 USD/měsíc.

11. Zyte (Scrapy Cloud)

Pro koho: Vývojáři a firmy, které potřebují enterprise scraping.

Zyte stojí za Scrapy a nabízí cloudovou platformu i . Řeší plánování, proxy i velké projekty.

- Nejlepší pro: Dev týmy, které provozují dlouhodobé scraping projekty.

- Cena: Od trialů po individuální enterprise nabídky.

12. Webscraper.io

Pro koho: Začátečníci, novináři a výzkumníci.

je pro extrakci dat klikáním. Je jednoduché, zdarma pro lokální použití a nabízí cloudovou službu pro větší úlohy.

- Nejlepší pro: Rychlé jednorázové scraping úkoly.

- Cena: Rozšíření zdarma; cloud plány od ~50 USD/měsíc.

13. ParseHub

Pro koho: Ne-technické publikum, které potřebuje víc než základní nástroje.

ParseHub je desktopová aplikace s vizuálním workflow pro scrapování dynamického obsahu včetně map a formulářů. Umí spouštět projekty v cloudu a nabízí API.

- Nejlepší pro: Digitální marketéry, analytiky a novináře.

- Cena: Free tier (200 stránek/běh); placené plány od 189 USD/měsíc.

14. Diffbot

Pro koho: Enterprise a AI firmy, které potřebují strukturovaná webová data ve velkém.

Diffbot využívá computer vision a NLP k z libovolné stránky. Nabízí API pro články, produkty a také rozsáhlý knowledge graph.

- Nejlepší pro: Market intelligence, finance a trénovací data pro AI.

- Cena: Prémiové, od ~299 USD/měsíc.

15. DataMiner

Pro koho: Ne-technické publikum, hlavně v sales, marketingu a žurnalistice.

DataMiner je pro rychlou extrakci webových dat klikáním. Má knihovnu hotových „receptů“ a umí export přímo do Google Sheets.

- Nejlepší pro: Rychlé úkoly typu export tabulek nebo seznamů do spreadsheetu.

- Cena: Free tier (500 stránek/den); Pro od ~19 USD/měsíc.

Srovnání top nástrojů typu AI Web Scraper: který sedí vašim potřebám?

Tady je rychlé srovnání, které ti pomůže vybrat:

| Nástroj | Využití AI/LLM | Snadnost použití | Výstup/Integrace | Ideální pro | Cena |

|---|---|---|---|---|---|

| Thunderbit | UI v přirozeném jazyce; AI navrhuje pole | Nejjednodušší (no-code chat) | Export do Sheets, Airtable, Notion | Ne-technické týmy | Free tier; Pro ~30 USD/měs. |

| Crawl4AI | Crawlování připravené pro AI; integrace LLM | Těžké (Python kód) | Knihovna/CLI; integrace přes kód | Devs pro rychlé AI datové pipeline | Zdarma |

| ScrapeGraphAI | LLM prompt pipeline pro scraping | Střední (trocha kódu nebo API) | API/SDK; JSON výstup | Devs/analytici stavící AI agenty | OSS zdarma; API 20+ USD/měs. |

| Firecrawl | Crawluje do Markdown/JSON pro LLM | Střední (API/SDK) | SDK (Py, Node, …); integrace LangChain | Devs napojující živá web data do AI | Zdarma + placený cloud |

| Browse AI | AI asistované klikání | Snadné (no-code) | 7000+ integrací (Zapier) | Ne-tech automatizace monitoringu webu | Free 50 běhů; 19+ USD/měs. |

| LLM Scraper | LLM parsuje stránku do schématu | Těžké (TS/JS kód) | Knihovna; JSON výstup | Devs, kteří chtějí AI parsování | Zdarma (vlastní LLM API) |

| Reader (Jina) | AI model extrahuje text/JSON | Snadné (jednoduché API volání) | REST API vrací Markdown/JSON | Devs přidávající web obsah do LLM | API zdarma |

| Bright Data | AI v scraping API; velká proxy síť | Těžké (API, technické) | API/SDK; streamy nebo datasety | Enterprise škála | Podle využití |

| Octoparse | AI auto-detekce seznamů | Střední (no-code app) | CSV/Excel, API pro výsledky | Polotechnické publikum | Free omezeně; 59–166 USD/měs. |

| Apify | Některé AI funkce (Actors, AI návody) | Těžké (skripty) | Bohaté API; integrace s LangChain | Devs pro vlastní scraping v cloudu | Free tier; pay-as-you-go |

| Zyte (Scrapy) | ML auto-extrakce; Scrapy framework | Těžké (Python kód) | API, Scrapy Cloud UI; JSON/CSV | Dev týmy, dlouhodobé projekty | Individuální cena |

| Webscraper.io | Bez AI (ruční šablony) | Snadné (rozšíření) | CSV stažení, Cloud API | Začátečníci, rychlé jednorázovky | Rozšíření zdarma; Cloud ~50 USD/měs. |

| ParseHub | Bez explicitního LLM; vizuální builder | Střední (no-code app) | JSON/CSV; API pro cloud běhy | Ne-dev pro složitější weby | Free 200 str.; 189+ USD/měs. |

| Diffbot | AI vision/NLP pro jakoukoli stránku; knowledge graph | Snadné (API volání) | API (Article/Product/…) + dotazy do Knowledge Graph | Enterprise, strukturovaná web data | Od ~299 USD/měs. |

| DataMiner | Bez LLM; komunitní recepty | Nejjednodušší (UI v prohlížeči) | Export Excel/CSV; Google Sheets | Ne-tech export do tabulek | Free omezeně; Pro ~19 USD/měs. |

Kategorie nástrojů: od vývojářských „tanků“ po byznysově přívětivé Web Scraper nástroje

Aby se v tom dalo líp orientovat, rozdělme si nástroje do pár skupin:

1. Vývojářské a open-source „těžké váhy“

- Příklady: Crawl4AI, LLM Scraper, Apify, Zyte/Scrapy, Firecrawl

- Silné stránky: Maximální flexibilita, škálování a možnost přizpůsobení. Ideální pro vlastní pipeline nebo integrace s AI modely.

- Nevýhody: Bez programování a konfigurace se nehneš.

- Použití: Vlastní datová pipeline, složité weby, integrace do interních systémů.

2. AI integrovaní scraping agenti

- Příklady: Thunderbit, ScrapeGraphAI, Firecrawl, Reader (Jina), LLM Scraper

- Silné stránky: Zmenšují propast mezi „vytáhnout data“ a „porozumět datům“. Díky přirozenému jazyku jsou mnohem přístupnější.

- Nevýhody: Některé nástroje jsou pořád ve vývoji; nemusí nabídnout úplně jemné řízení.

- Použití: Rychlé odpovědi/datasety, autonomní agenti, napojení živých dat do LLM.

3. No-code/low-code scrapery pro byznys

- Příklady: Thunderbit, Browse AI, Octoparse, ParseHub, , DataMiner

- Silné stránky: Uživatelsky přívětivé, minimální nebo žádné programování, vhodné pro běžné firemní úkoly.

- Nevýhody: Můžou mít problém s extrémně složitými weby nebo obří škálou.

- Použití: Lead gen, monitoring konkurence, výzkum, jednorázové exporty.

4. Enterprise datové platformy a služby

- Příklady: Bright Data, Diffbot, Zyte

- Silné stránky: Kompletní řešení, managed služby, compliance a spolehlivost ve velkém.

- Nevýhody: Vyšší cena a náročnější onboarding.

- Použití: Velké always-on pipeline, market intelligence, trénovací data pro AI.

Jak vybrat správný AI web crawler pro vaše potřeby scrapování webových stránek

Vybrat správný nástroj může působit jako věda, takže tady je jednoduchý postup krok za krokem:

- Ujasni si cíle a požadavky na data: Jaké weby a jaká data potřebuješ? Jak často? V jakém objemu? A co s nimi budeš dělat dál?

- Zhodnoť technické schopnosti: Bez kódu? Zkus Thunderbit, Browse AI nebo Octoparse. Trocha skriptování? LLM Scraper nebo DataMiner. Silné dev schopnosti? Crawl4AI, Apify nebo Zyte.

- Zvaž frekvenci a škálu: Jednorázově? Využij free nástroje. Opakovaně? Hledej plánování. Ve velkém? Enterprise nebo open-source ve škále.

- Rozpočet a cenový model: Free plány jsou super na test. Předplatné vs. platba podle využití záleží na tvém scénáři.

- Trial a proof of concept: Otestuj pár nástrojů na reálných datech. Většina má free tier.

- Údržba a podpora: Kdo to opraví, když se web změní? No-code s AI často zvládne drobné změny automaticky; open-source je na tobě nebo komunitě.

- Přiřaď nástroje ke scénářům: Sales tým sbírá leady? Thunderbit nebo Browse AI. Výzkumník sbírá tweety? DataMiner nebo . AI model potřebuje články? Jina Reader nebo Zyte. Stavíš srovnávač? Apify nebo Zyte.

- Měj záložní plán: Někdy konkrétní web prostě nesedne jednomu nástroji. Je fajn mít alternativu.

„Správný“ nástroj je ten, který ti dodá potřebná data s nejmenším třením a v rámci rozpočtu. Občas to znamená kombinaci více nástrojů.

Thunderbit vs. tradiční nástroje typu Web Scraper: čím vyčnívá?

Pojďme konkrétně, v čem je Thunderbit jinde:

- Rozhraní v přirozeném jazyce: Žádný kód, žádné klikací akrobacie. Prostě popíšeš, co chceš ().

- Nulová konfigurace a návrhy šablon: Thunderbit automaticky rozpozná stránkování, podstránky a navrhne šablony pro běžné weby ().

- Čištění a obohacení dat pomocí AI: Shrnutí, kategorizace, překlad i obohacení dat už během scrapování ().

- Méně starostí s údržbou: AI je odolnější vůči drobným změnám webu, takže se méně „láme“.

- Integrace do byznys nástrojů: Přímý export do Google Sheets, Airtable, Notion — žádné ruční CSV kolečko ().

- Rychlá cesta k výsledku: Od nápadu k datům během minut, ne dnů.

- Křivka učení: Pokud umíš procházet web a popsat, co potřebuješ, zvládneš Thunderbit.

- Univerzálnost: Weby, PDF, obrázky a další — v jednom nástroji.

Thunderbit není jen scraper — je to datový parťák, který zapadne do workflow, ať jsi v sales, marketingu, ecommerce nebo realitách.

Best practices pro scrapování webových stránek s AI Web Scraper nástroji

Aby sis z AI scraperů vytáhl maximum, tady jsou moje top tipy:

- Jasně si definuj, jaká data chceš: Jaká pole, kolik stránek a v jakém formátu.

- Využívej AI návrhy: Detekce polí a AI doporučení pomůžou zachytit důležitá data, která by ti mohla utéct ().

- Začni v malém a ověřuj: Otestuj to na vzorku, zkontroluj výstup a dolaď.

- Počítej s dynamickým obsahem: Ověř, že nástroj umí interakce (stránkování, infinite scroll apod.).

- Respektuj pravidla webu: Mrkni na robots.txt, nesbírej citlivá data a dodržuj rate limity.

- Integruj pro automatizaci: Exporty a webhooky napojí data rovnou do workflow.

- Hlídání kvality dat: Dělej sanity check, post-processing a monitoring chyb.

- Piš stručné a konkrétní prompty: U AI nástrojů platí, že jasné zadání = lepší výsledek.

- Uč se z komunity: Fóra a komunity jsou skvělé na tipy i řešení problémů.

- Buď v obraze: AI nástroje se vyvíjejí rychle — sleduj nové funkce.

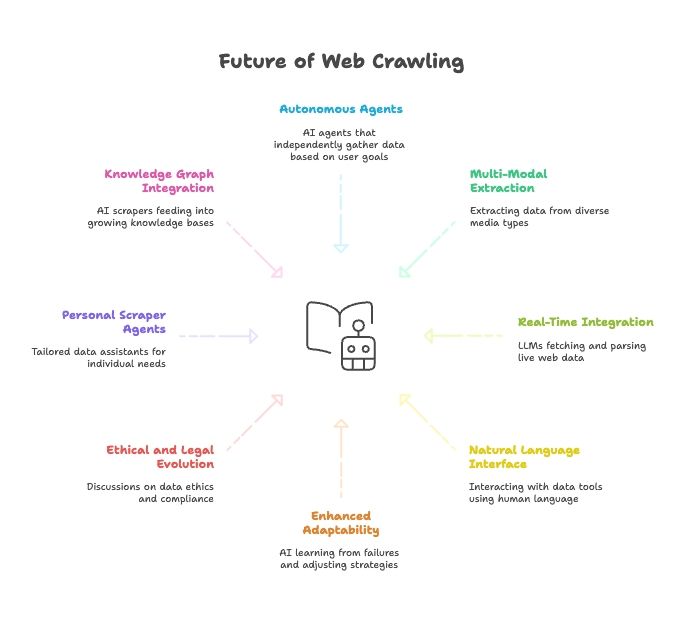

Budoucnost web scrapingu: AI, LLM a nástup agentů typu Web Scraper v přirozeném jazyce

Do budoucna se propojení AI a web scrapingu bude jen zrychlovat:

- Plně autonomní scraping agenti: Brzy řekneš agentovi jen cílový výsledek a on sám vymyslí, jak data získat.

- Multimodální extrakce: Data se budou tahat z textu, obrázků, PDF a dokonce i videí.

- Integrace v reálném čase do AI modelů: LLM budou mít vestavěné moduly pro získávání a parsování živých webových dat.

- Všechno v přirozeném jazyce: S datovými nástroji budeme mluvit jako s lidmi — sběr i transformace dat bude dostupná všem.

- Ještě vyšší adaptabilita: AI scrapery se budou učit z neúspěchů a automaticky měnit strategii.

- Etika a právo: Přibude debat o etice dat, compliance a fair use.

- Osobní scraping agenti: Představ si osobního asistenta, který ti sbírá zprávy, nabídky práce a další obsah na míru.

- Napojení na knowledge graphy: AI scrapery budou průběžně doplňovat znalostní báze a posouvat AI dál.

Pointa? Budoucnost web scrapingu je těsně svázaná s budoucností AI. Nástroje jsou každý den chytřejší, autonomnější a dostupnější.

Závěr: jak odemknout byznys hodnotu díky správnému AI web crawleru

Web scraping se díky AI posunul z okrajové technické dovednosti na klíčovou firemní schopnost. Těchto 15 nástrojů ukazuje to nejlepší, co je v roce 2026 možné — od vývojářských powerhouse řešení po byznysové asistenty.

Skutečné tajemství? Správná volba nástroje může dramaticky zvýšit hodnotu, kterou z webových dat získáš. Pro ne-technické týmy je Thunderbit nejjednodušší cesta, jak proměnit web na strukturovanou databázi připravenou pro analýzu — bez kódu, bez komplikací, jen výsledky.

Ať už sbíráš leady, hlídáš konkurenci nebo krmíš další generaci AI modelu, vyplatí se ujasnit si potřeby, vyzkoušet pár nástrojů a zjistit, co ti sedí. A pokud chceš zažít budoucnost web scrapingu už dnes, . Potřebné insighty jsou jen jeden prompt daleko.

Chceš víc? Mrkni na — najdeš tam detailní články, návody i novinky ze světa AI extrakce dat.

Další čtení:

Nejčastější dotazy (FAQ)

1. Co je AI web crawler a čím se liší od tradičních web scraperů?

AI web crawler využívá zpracování přirozeného jazyka a strojové učení k pochopení, extrakci a strukturování webových dat. Na rozdíl od tradičních scraperů, které vyžadují ruční kódování a XPath selektory, AI nástroje zvládají dynamický obsah, přizpůsobují se změnám layoutu a rozumí zadání v běžném jazyce.

2. Kdo by měl používat AI nástroje pro web scraping jako Thunderbit?

Thunderbit je navržený pro ne-technické i technické uživatele. Hodí se pro sales, marketing, operations, výzkum i ecommerce — všude tam, kde potřebuješ získat strukturovaná data z webů, PDF nebo obrázků bez psaní kódu.

3. Jaké funkce dělají Thunderbit výjimečným mezi AI web crawlery?

Thunderbit nabízí rozhraní v přirozeném jazyce, víceúrovňové crawlování, automatické strukturování dat, podporu OCR a plynulé exporty do nástrojů jako Google Sheets a Airtable. Nechybí ani AI návrhy polí a hotové šablony pro populární weby.

4. Existují v roce 2026 bezplatné možnosti AI web scrapingu?

Ano. Řada nástrojů jako Thunderbit, Browse AI nebo DataMiner nabízí bezplatné plány s omezeným využitím. Pro vývojáře jsou tu open-source možnosti jako Crawl4AI a ScrapeGraphAI, které jsou zdarma, ale vyžadují technické nastavení.

5. Jak vybrat správný AI web crawler pro moje potřeby?

Začni tím, že si určíš cíle, technické možnosti, rozpočet a požadavky na škálu. Pokud chceš no-code a jednoduché řešení, Thunderbit nebo Browse AI jsou skvělé volby. Pro velké objemy nebo custom potřeby se víc hodí Apify nebo Bright Data.