Vyhledávání na GitHubu pro „amazon scraper“ vrací zhruba . Když to zúžíte na repozitáře, do kterých se v posledních šesti měsících pushovalo, zůstane asi — sotva 20 %. Zbytek? Opuštěné návody, zastaralé obaly a skripty, které přestaly fungovat ve chvíli, kdy Amazon zpřísnil obranu.

Strávil jsem hodně času procházením repozitářů s Amazon scraperem, čtením GitHub Issues a sledováním komunitních vláken na Redditu a Stack Overflow. Vzorec je pořád stejný: někdo narazí na populární repo, hodinu ho nastavuje, jednou ho spustí a narazí na zeď CAPTCHA nebo chyb 503. Proti-botí postoj Amazonu v roce 2026 už není stejný jako před dvěma lety — TLS fingerprinting, behaviorální analýza a agresivní nasazování CAPTCHA udělaly ze starého plánu „otoč user-agent a doufej v nejlepší“ téměř nepoužitelnou strategii. Tenhle průvodce popisuje postupy, které skutečně dávají smysl, pokud chcete z GitHub repozitáře získávat spolehlivá data z Amazonu, a co dělat, když se váš scraper rozbije — tedy ne jestli, ale kdy.

Co je Amazon Scraper na GitHubu (a proč jich tolik selhává)?

Repozitář s Amazon scraperem na GitHubu je obvykle open-source skript — nejčastěji v Pythonu, Node.js nebo postavený na Scrapy — který z Amazon stránek extrahuje strukturovaná data. Cílová data jsou známá: název produktu, cena, ASIN, hodnocení, počet recenzí, dostupnost, informace o prodejci, karty ve výsledcích vyhledávání a text recenzí.

Architektura bývá většinou jednoduchá:

- HTTP klient nebo headless prohlížeč stáhne stránku.

- HTML nebo JSON parser vytáhne požadovaná pole.

- Data se uloží do CSV, JSON nebo databáze.

Repozitáře obvykle spadají do čtyř skupin:

- Lehké Python knihovny (např. )

- Scrapy spideri (např. )

- Automatizátory prohlížeče Selenium nebo Playwright

- Projekty s API obalem, které jsou ve skutečnosti front-endem ke komerční scrapingové službě (např. )

Vzorec selhání je předvídatelný. Většina repozitářů přestane fungovat, protože:

- Amazon změní rozložení stránky nebo HTML fragmenty

- Amazon místo skutečného obsahu vrátí 503 nebo CAPTCHA

- TLS a HTTP fingerprint scraperu už nepůsobí jako běžný prohlížeč

- Nesoulad v lokalitě, jazyce nebo hlavičkách vzbudí podezření

- Správce repo projekt po vyřešení původního úzkého use case opustí

Vysoký počet hvězdiček a „aktuálně použitelný“ jsou dvě úplně odlišné věci. V auditu, který jsem pro tenhle článek provedl, vypadaly v roce 2026 jasně aktivně jen asi tři z osmi široce viditelných repozitářů.

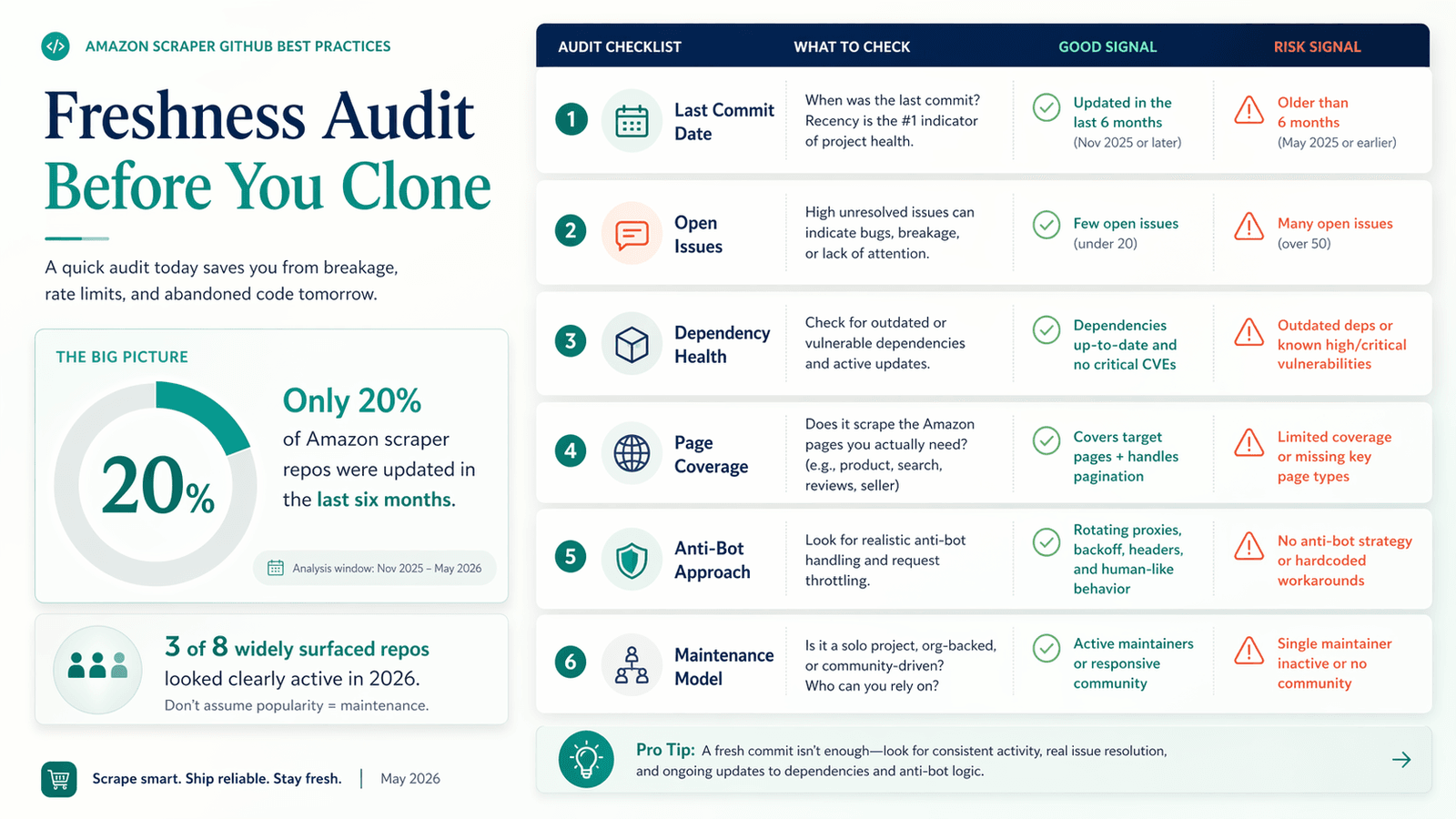

Než naklonujete jakýkoli Amazon Scraper GitHub repo, proveďte audit čerstvosti pro rok 2026

Tahle kontrola je pro Amazon důležitější než pro většinu jiných cílů. Obranný postoj Amazonu se mění rychleji než u běžného e-commerce webu, takže repo, které funguje bez problému na brožurové stránce, může být na Amazonu za pár týdnů k ničemu. Přesto většina seznamů „best amazon scraper github“ doporučuje repa, aniž by kontrolovala, jestli ještě fungují. Uživatelé pak ztrácejí hodiny nastavováním rozbitých nástrojů.

Jak zjistit, jestli je GitHub repo stále živé

Než něco git clonenete, projděte si tyto kontroly:

- Datum posledního commitu: Cokoli staršího než 6 měsíců je u Amazonu silný varovný signál.

- Otevřené issues vs. rychlost odpovědí: V záložce Issues vyhledejte „captcha“, „503“, „blocked“ a „not working“. Pokud se tyto hlášky hromadí bez odpovědi správce, dejte od toho ruce pryč.

- Zdraví závislostí: Otevřete

requirements.txtnebopackage.json. Zastaralé knihovny (např. starýrequestsbez moderní práce s TLS) jsou červená vlajka. - Pokrytí typů stránek Amazonu: Umí repo produktové stránky, výsledky vyhledávání A recenze? Nebo jen jednu z nich?

- Anti-bot přístup: Natvrdo zadané hlavičky bez podpory proxy je přístup z roku 2023, který nepřežije rok 2026.

Kontrolní seznam čerstvosti Amazon Scraper GitHub repozitáře

| Signál čerstvosti | Co zkontrolovat | Červená vlajka 🚩 |

|---|---|---|

| Datum posledního commitu | Feed commitů nebo datum push na repo | Starší než 6 měsíců |

| Otevřená issues | Záložka Issues — filtrovat „captcha“, „503“, „blocked“ | Opakované rozbíjení bez odpovědí správce |

| Zdraví závislostí | requirements.txt / package.json | Zastaralé knihovny, žádná moderní TLS strategie |

| Pokrytí stránek Amazonu | README + ukázky kódu | Zvládá jen jeden typ stránky (např. produktové stránky, ale ne vyhledávání nebo recenze) |

| Anti-bot přístup | Zdrojový kód, nastavení proxy | Jen natvrdo zadané hlavičky a UA stringy |

| Model údržby | Je to skutečný scraper, návod, nebo komerční API wrapper? | Repo je ve skutečnosti jen front-end placené služby |

Co audit ve skutečnosti odhalil

Porovnal jsem osm široce viditelných Amazon scraper repozitářů podle těchto kritérií. Výsledky nejsou příliš povzbudivé:

This paragraph contains content that cannot be parsed and has been skipped.

Plán proti blokaci: jak se nenechat zablokovat s Amazon scraperem z GitHubu

Zablokování je největší bolestivý bod pro kohokoli, kdo používá projekt amazon scraper github. Obecná rada typu „používejte proxy a střídejte user-agenty“ už nestačí. Anti-bot stack Amazonu pro roky 2025–2026 zahrnuje TLS fingerprinting, behaviorální analýzu a agresivní nasazování CAPTCHA. Potřebujete vícvrstvý přístup.

Shoda TLS fingerprintu: proč vás prostý requests dostane do blokace

Tohle je jedna z nejčastěji přehlížených technik proti blokaci. TLS fingerprinting funguje takto: když váš skript otevře zabezpečené spojení s Amazonem, server může podle způsobu „podání ruky“ zjistit spoustu o klientovi — nabízené cipher suites, pořadí rozšíření, nastavení HTTP/2. Prohlížeče používají relativně pevné TLS a HTTP/2 nastavení a tyto kombinace lze fingerprintovat pomocí technik jako .

Běžný requests a standardní httpx umí kopírovat hlavičky, ale neumí kopírovat chování TLS a HTTP/2 podobné Chromu. Amazon ten rozdíl pozná.

to řeší přímo. Nabízí impersonaci prohlížeče — podporované cíle zahrnují chrome136, safari184 a firefox133 — takže TLS fingerprint vašeho HTTP klienta odpovídá skutečnému prohlížeči. Dokumentace výslovně varuje před generováním náhodných řetězců JA3: fingerprinty prohlížečů jsou většinou fixní pro konkrétní verzi a náhodný nesmysl se detekuje snadněji než kopírovaný skutečný fingerprint.

Komunitní data tomu odpovídají. potvrzuje, že argument impersonate je užitečný, protože střídá profily prohlížeče a drží hlavičky v souladu. Další uvádí, že Amazon blokuje klienty na základě TLS fingerprintu „asi po měsíci nebo dvou“. se přímo ptá, zda Amazon fingerprintuje python-requests (spoiler: ano).

Pokud jako svůj první Amazon klient stále používáte prostý requests, změňte tuhle představu dřív, než budete měnit cokoli jiného.

Správně provedená rotace proxy (ne jen „používejte proxy“)

Smyslem proxy není rotovat co nejvíc. Smyslem je, aby relace působily uvěřitelně.

Residential vs. datacentrové: Datacentrové proxy jsou levnější, ale snadněji se detekují. Residential proxy stojí víc, ale Amazon je mnohem hůř označí jako podezřelé. začíná na 4,00 USD/GB pay-as-you-go a u větších plánů klesá na 3,50 USD/GB. začíná na 6 USD/GB. Amazon patří do kategorie „sofistikovaný cíl“, kde se za residential proxy vyšší cena vyplatí.

Rotace po požadavku vs. po relaci: Tady většina návodů chybuje. Rotace proxy při každém požadavku, zatímco cookies a hlavičky zůstávají stejné, může působit méně lidsky, ne více. Bezpečnější vzor:

- Procházení vyhledávání → produkt → recenze držte pokud možno na stejné sticky relaci

- Relaci měňte při zahájení nové vyhledávací cesty, ne při každém požadavku

- Rotujte mezi relacemi, ne náhodně uvnitř jedné relace prohlížení

Jeden poznamenal, že běžné ISP IP adresy si na populárních e-commerce webech vedly výrazně hůř než mobilní IP adresy. Další uvádělo blokace i při rotaci user-agentů a residential proxy — dobrá připomínka, že proxy sama o sobě nestačí.

Tempo požadavků, backoff a rate limiting

Stránky 503 na Amazonu nejsou náhodná smůla. Jsou to zpětné signály.

o scrapování více než 500 ASINů uváděl, že se chyba 503 objevila pokaždé ve stejném bodě, kolem ASIN 101, i při čekání mezi požadavky. Vzor je starý, ale poučení platí dodnes: surový objem z jedné IP nebo jednoho fingerprintu nakonec spustí obranu.

Doporučené tempo pro DIY GitHub scrapery:

- Náhodné prodlevy mezi požadavky (ne pevné intervaly, ty jdou detekovat)

- 2 až 5 sekund mezi veřejnými produktovými požadavky u jednoduchých HTTP klientů

- Exponenciální backoff po 503 nebo CAPTCHA — místo okamžitého opakování postupně zpomalit

- Nižší souběžnost, než si myslíte, že potřebujete

- Fail-open logging místo úzkých retry smyček

Většina amazon scraper github repozitářů nemá vestavěný rate limiting. Budete si ho muset doplnit sami.

Orchestrace hlaviček: víc než jen User-Agent stringy

Amazon kontroluje celou sadu hlaviček, ne jen User-Agent.

Realistická sada hlaviček prohlížeče by měla obsahovat:

User-AgentAcceptAccept-LanguageAccept-EncodingSec-CH-*nápovědy, pokud jsou vhodné- Chování připojení konzistentní s vybraným profilem prohlížeče

Hlavičky by měly odpovídat lokalitě tržiště. Jeden zjistil, že stejná botí konfigurace byla detekována jen v některých lokalitách, a jiný komentující ukazoval na regionální hlavičky jako Accept-Language.

Pravidlo zní: hlavičky, TLS/profil prohlížeče a geografické umístění proxy si nesmí odporovat. Neposílejte hlavičky Chromu s UA pro Firefox. Nepoužívejte US proxy s Accept-Language: de-DE.

Práce s CAPTCHA: kdy řešit a kdy ustoupit

Když narazíte na CAPTCHA, Amazon už je podezřívavý. Její vyřešení neresetuje váš trust score.

U ojedinělých, málo častých CAPTCHA událostí:

- Balíček PyPI je čistě Pythonový řešič textových CAPTCHA od Amazonu, i když poslední verze je z května 2023 — berte ho jako taktický nástroj, ne jako dlouhodobou strategii

- uvádí Amazon Captcha za 0,45 USD na 1 000 řešení

U opakovaných CAPTCHA smyček:

- Přestaňte je řešit a začněte ustupovat

- Opakované CAPTCHA znamenají, že relace je spálená — jejich řešení neobnoví důvěru ve fingerprint, historii relace ani reputaci IP

- Pokud se CAPTCHA shlukují podle subnetu proxy, problém je v síťové vrstvě, ne v parseru

Kdy skutečně potřebujete headless prohlížeč a kdy je to přestřelené

Špatný instinkt je spouštět Playwright na všechno.

Dobré případy pro prohlížeč:

- Výsledky vyhledávání závislé na renderování JavaScriptem nebo na stavu daném lokalitou

- Toky recenzí, které přesměrovávají na přihlašovací stránky

- Workflow, kde cookies a kontext prohlížeče hrají větší roli než surová rychlost

Špatné případy pro prohlížeč:

- Běžné veřejné produktové stránky

- Statická extrakce detailů produktu, kde stačí HTTP klient napodobující prohlížeč

- Velkoobjemové dávkové stahování, kde záleží na efektivitě výpočtu

Začněte s nejlehčím klientem, který funguje. Jedno o scrapování ve velkém popisovalo postup: začít s requests, pak curl_cffi a k plnému prohlížeči jít až tehdy, když lehčí možnosti selžou. Headless prohlížeče jsou při scrapování produktových stránek Amazonu výrazně pomalejší a náročnější na zdroje než HTTP klienti.

Rozhodovací matice proti blokaci pro Amazon Scraper GitHub projekty

| Scénář | Doporučený přístup | Proč |

|---|---|---|

| Veřejné produktové stránky (malý rozsah) | curl_cffi + sticky residential relace | Nejlevnější cesta, která stále působí jako prohlížeč |

| Stránky s výsledky vyhledávání | Nejprve curl_cffi, Playwright jen pokud renderování nebo stav rozbije HTTP | Vyhledávání je stavovější a citlivější na lokalitu |

| Recenze (vyžadují přihlášení) | Režim prohlížeče se skutečnými cookies/relací | Přihlášení a dynamické toky recenzí se přes čisté HTTP napodobují hůř |

| Velký rozsah (5k+ denně) | Spravované scraping API, unlocker nebo no-code platforma | Samotný DIY GitHub kód se z toho stává infrastrukturním problémem |

Když se váš Amazon Scraper GitHub projekt rozbije: mějte no-code záložní plán

Každý zkušený scraper má plán B.

Aktualizace Amazonu nakonec v nejhorší možnou chvíli rozbijí jakékoli GitHub repo. Pro e-commerce týmy znamená rozbitý scraper zmeškané změny cen, zastaralá data o konkurenci a díry v dashboardech.

Mnoho lidí, kteří hledají „amazon scraper github“, jsou ve skutečnosti business uživatelé — e-commerce operátoři, marketéři, výzkumníci FBA — kteří zkusili kódovací řešení, protože nenašli nic lepšího. Fórum také ukazuje reálnou frustraci z oficiálního : omezující přístup, omezená data a , které mnoho prodejců nesplní.

Proč Amazon scrapery z GitHubu potřebují neustálou údržbu

Výše uvedený audit to ukazuje jasně:

- Zastaralá repa hromadí hlášení o rozbití bez oprav

- „Funkční“ repa už v README otevřeně mluví o anti-bot opatřeních

- Komunitní vlákna se čím dál víc točí kolem TLS fingerprintů, CAPTCHA smyček a kvality proxy — ne kolem CSS selektorů

Pro business uživatele je tenhle nárok na údržbu skutečná skrytá cena. Repo je zdarma. Váš čas, který v 2 ráno strávíte debugováním, zdarma není.

Thunderbit jako praktická alternativa k Amazon scraperu

nabízí , která bez psaní kódu vytáhne název, cenu, ASIN, hodnocení, značku, dostupnost, místo odeslání a původní URL.

Jak to v praxi vypadá:

- Scraping na 2 kliknutí místo nastavování Python prostředí, závislostí a proxy konfigurace

- Okamžitá Amazon šablona — bez AI režie, jen extrakce na 1 kliknutí

- Režim scrapování v prohlížeči pro stránky vyžadující přihlášení (například stránky s recenzemi, které uživatele GitHub scraperů frustrují)

- Cloud scraping pro veřejné produktové stránky rychlostí (50 stránek najednou)

- Bezplatný export do Google Sheets, Airtable, Notion, Excel — nejen CSV/JSON

- Plánovaný scraper pro průběžné sledování cen

- AI se přizpůsobí změnám rozložení — bez údržbové zátěže na vaší straně

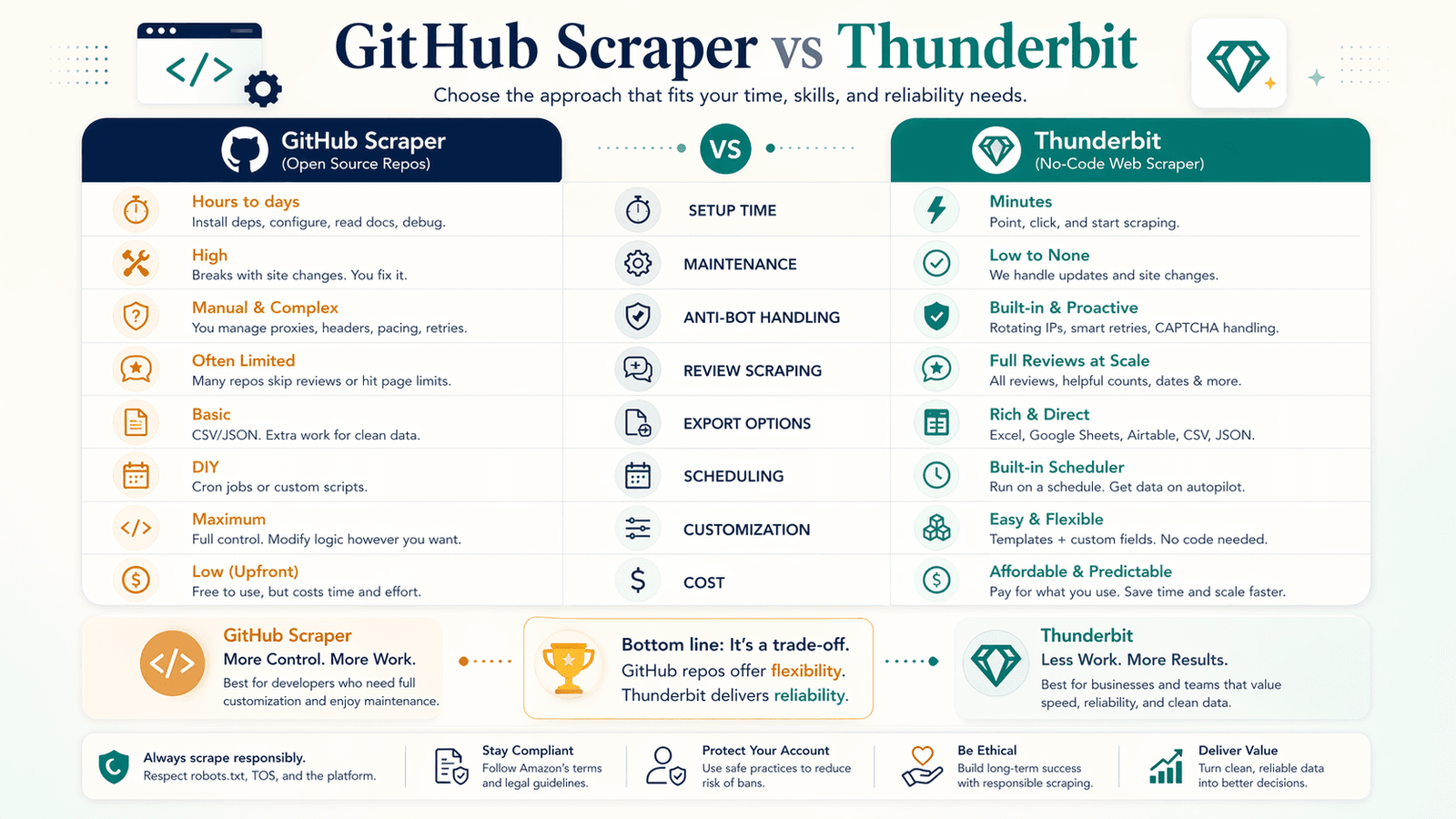

GitHub Amazon Scraper vs. Thunderbit: upřímné srovnání

| Faktor | GitHub scraper (např. AmzPy) | Thunderbit |

|---|---|---|

| Doba nastavení | 15–60 min (Python, závislosti, proxy) | ~2 min (instalace Chrome rozšíření) |

| Údržba | Rozbití opravujete vy | AI se přizpůsobuje změnám rozložení |

| Zpracování anti-bot ochrany | DIY (proxy, hlavičky, TLS) | Vestavěné (cloud + režim prohlížeče) |

| Scrapování recenzí (po přihlášení) | Složitá správa relací | Režim scrapování v prohlížeči |

| Export dat | Jen CSV/JSON | Sheets, Airtable, Notion, Excel, CSV, JSON |

| Plánování | DIY (cron, Airflow atd.) | Vestavěný plánovaný scraper |

| Přizpůsobení | Vyšší | Nižší |

| Cena | Zdarma (plus náklady na proxy) | K dispozici je bezplatný plán; kreditový model |

Upřímný kompromis: GitHub repozitáře nabízejí větší míru přizpůsobení; Thunderbit nabízí větší spolehlivost. Pokud vašemu týmu záleží víc na dostupnosti než na flexibilitě, no-code cesta bývá rozumnější volba.

Nejlepší postupy pro plánované a opakované scrapování Amazonu

Většina amazon scraper github projektů je dělaná pro jednorázové spuštění, ale skutečné business use cases — monitoring cen, sledování zásob, analýza konkurence — vyžadují opakované scrapování. GitHub repozitáře téměř nikdy nenabízejí plánování nativně, takže si uživatelé musejí pomáhat přes cron, Airflow nebo workflow v n8n.

DIY plánování pro GitHub Amazon scrapery

Minimální životaschopné řešení pro opakované běhy:

- Cron job na Linuxu nebo macOS, který spouští skript podle plánu

- Logy pouze pro zápis (append-only), abyste mohli později ladit selhání

- Deduplikace podle ASIN + časové razítko, abyste neukládali stejná data dvakrát

- Upozornění na selhání (i jednoduchý e-mail při nenulovém exit kódu), abyste věděli, když běh ve 3 ráno spadne

Pro složitější týmy:

- n8n pro lehkou automatizaci workflow (často zmiňované v komunitních vláknech)

- Airflow pro těžší plánované pipeline

- Stav v databázi, pokud potřebujete rozdíly a historii

Klíčový postup není samotný scheduler — ale správa stavu. Sledujte poslední úspěšný běh, poslední sadu ASINů, změněné ceny a neúspěšné URL.

Plánování jednodušeji s Thunderbit

Thunderbitův vám dovolí popsat interval běžnou češtinou, zadat URL a kliknout na „Naplánovat“. AI převede přirozený jazyk na cron plán — bez technického nastavování. Pro ne-technické e-commerce týmy, které hlídají ceny nebo uvedení produktů konkurence, je to výrazné snížení provozní režie.

Nejlepší postupy pro opakované Amazon scrapes

Platí bez ohledu na nástroj:

- Deduplikujte podle ASIN + časového okna — neukládejte stejný produkt v jednom běhu dvakrát

- Ukládejte ceny jako čísla, ne jako surové řetězce — ušetří to následné čištění

- Ke každému řádku přidávejte čas scrapování — budete je potřebovat pro trendovou analýzu

- Sledujte rozdíly, ne jen aktuální stav — „cena klesla o 12 % od minulého týdne“ je užitečnější než „cena je 24,99 $“

- Upozorňujte na smysluplné změny — pokles ceny konkurenta o 15 % stojí za notifikaci; výkyv 0,5 % je šum

- Přemýšlejte o úložišti dat — ploché soubory stačí pro malé běhy; u 5k+ ASINů denně zvažte databázi nebo cloudovou tabulku

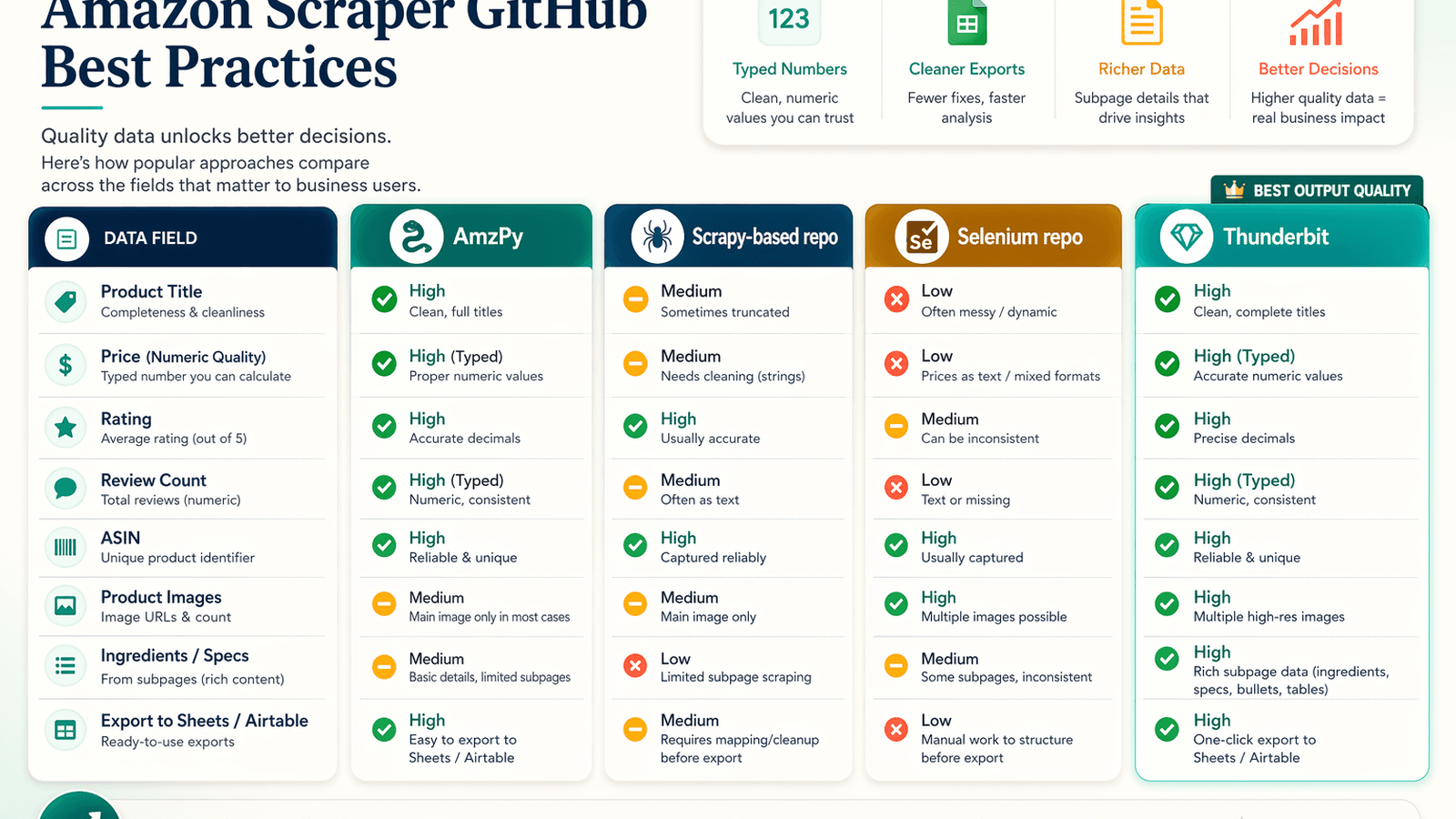

Kvalita výstupu vedle sebe: co jednotlivé přístupy Amazon Scraper GitHub skutečně vracejí

Nikdo nesrovnává skutečnou kvalitu výstupu napříč amazon scraper github repozitáři. Uživatelům velmi záleží na kvalitě dat — „který nástroj dává nejčistší a nejúplnější data“ — ale musejí si každý repo naklonovat a otestovat sami. Tahle část tu mezeru vyplňuje.

Co populární GitHub repozitáře skutečně extrahují (a co vynechávají)

Na základě ukázek v README, veřejných příkladů a dokumentovaných výstupních formátů:

| Přístup | Co jasně extrahuje | Běžné mezery / kompromisy |

|---|---|---|

| amzpy | Název, cena, měna, URL obrázku, hodnocení, recenze, varianty, ASIN | Zaměřené na produktové stránky; méně bohaté na celé recenze/specifikační sekce |

| tducret/amazon-scraper-python | CSV s názvem, hodnocením, počtem recenzí, URL produktu, URL obrázku, ASIN | Zastaralé, zaměřené na listingy, slabý anti-bot příběh |

| python-scrapy-playbook scraper | Výsledky vyhledávání, produktové stránky, recenze, CSV/JSON pipeline | Úroveň návodu; spoléhá na externí proxy middleware; pravděpodobně bude potřeba víc čištění |

| omkarcloud/amazon-scraper | Vyhledávání, kategorie, detaily, top recenze, mnoho obrázků/videí/specifikací | Není to surový scraper — je to spravovaná API služba |

| Thunderbit Amazon template | Název, cena, ASIN, značka, hodnocení, recenze, dostupnost, původ odeslání, obohacení substránek | Menší kontrola na úrovni kódu než u vlastních skriptů |

Tabulka srovnání kvality výstupu

| Datové pole | AmzPy | Repo založené na Scrapy | Repo se Selenium | Thunderbit |

|---|---|---|---|---|

| Název produktu | ✅ | ✅ | ✅ | ✅ |

| Cena (číslo) | ⚠️ řetězec | ✅ | ⚠️ řetězec | ✅ (číselný typ) |

| Hodnocení | ✅ | ✅ | ✅ | ✅ |

| Počet recenzí | ❌ | ✅ | ✅ | ✅ |

| ASIN | ✅ | ✅ | ✅ | ✅ |

| Obrázky produktu | ❌ | ⚠️ jen náhled | ✅ | ✅ (plné rozlišení, k exportu) |

| Ingredience / specifikace | ❌ | ❌ | ❌ | ✅ (přes scraping substránek + AI) |

| Export do Sheets/Airtable | ❌ | ❌ | ❌ | ✅ zdarma |

Proč na formátování dat záleží business uživatelům

Nečistá data vytvářejí skrytou práci. I úspěšný scraper může být provozní selhání, pokud:

- Ceny jsou řetězce se символy měny místo čistých čísel

- Chybějící hodnoty jsou nekonzistentní (prázdný řetězec vs. null vs. „N/A“)

- Obrázky jsou jen nízkorozlišovací náhledy

- Pole s recenzemi nebo specifikacemi potřebují před analýzou dodatečné zpracování

Pro e-commerce týmy má čistá data přímý vliv na rychlost analýzy i rozhodování. Thunderbit AI formátuje data podle typu — čísla jako čísla, data jako data, URL jako URL — takže jsou okamžitě připravená k použití. GitHub repozitáře se v tomhle směru výrazně liší a čas potřebný na čištění rychle narůstá.

Rychlá referenční kontrola: checklist nejlepších postupů pro Amazon Scraper GitHub

- Před klonováním zkontrolujte datum posledního commitu. Starší než šest měsíců je u Amazonu silný varovný signál.

- Před nastavením prohledejte issues na „captcha“, „503“, „blocked“ a „not working“.

- Upřednostněte

curl_cffinebo jiný HTTP klient napodobující prohlížeč před prostýmrequests. - Držte hlavičky, TLS profil, jazyk a geografii proxy v souladu — žádné rozporuplné kombinace.

- Používejte sticky relace pro navigační toky; neotáčejte vše po každém požadavku naslepo.

- Přidejte náhodné tempo a exponenciální backoff.

- Opakovanou CAPTCHA berte jako spálenou relaci, ne jako hádanku k brute-force řešení.

- Headless prohlížeče používejte jen tehdy, když HTTP klient nedokáže stránku spolehlivě reprodukovat.

- Ukládejte checkpointy a stav, aby šlo neúspěšné běhy bezpečně obnovit.

- Mějte záložní plán — ať už jde o spravované API nebo no-code nástroj jako .

Právní a etické aspekty scrapování Amazonu v roce 2026

Pár věcí, které je dobré stručně znát.

Postoj Amazonu je restriktivní a dál se zpřísňuje. Nejsilnější signály:

- Vlastní nápovědné stránky Amazonu nyní vracejí s textem: „To discuss automated access to Amazon data please contact api-services-support@amazon.com.“

- zakazuje širokou škálu dynamických, recenzních, profilových, wishlistových a offer-listing cest.

- výslovně namítá proti skrytému nebo maskovanému přístupu agentů, obcházení bezpečnostních opatření a nepravdivému označování agenta za Google Chrome. Amazon o incidentu také vydal .

- Amazon na konci roku 2025 proti crawlerům OpenAI.

Praktické riziko je zjevně vyšší, když přecházíte z veřejných produktových stránek na přihlášené toky, maskovanou automatizaci nebo vysokobjemovou komerční extrakci. Tohle není právní rada — pro vaši konkrétní situaci se poraďte s vlastním právním týmem.

Klíčová doporučení: jak získat spolehlivá data z Amazonu a neskončit v blokaci

Podle důležitosti:

- Auditujte před klonováním. Předpokládejte, že většina výsledků na GitHubu je zastaralá, jde o návody nebo obaly kolem komerčních API.

- Nejdřív vylepšete síťovou vrstvu. TLS fingerprinting a konzistence relace jsou důležitější než HTML selektory.

- Používejte sticky residential relace, ne náhodný chaos v proxy. Rotujte mezi relacemi, ne uvnitř nich.

- Tempo požadavků přizpůsobte běžnému uživateli, ne zátěžovému testu. Náhodné prodlevy a exponenciální backoff jsou nepřekročitelné.

- Ojedinělé CAPTCHA řešte; relace s opakovanými výzvami ukončujte. Nepokoušejte se brute-force prolomit spálený fingerprint.

- Mějte záložní variantu. Amazon během týdne něco změní a váš GitHub scraper se rozbije. Udržovaný no-code nástroj jako nebo spravované API mohou udržet váš datový pipeline při životě, zatímco debugujete.

- Upřednostňujte kvalitu výstupu. Čistá, typově správná data ušetří víc času downstream než rychlý, ale chaotický scraper.

Pokud vám jde víc o spolehlivost než o přizpůsobení, Thunderbit nabízí udržovanou alternativu — podívejte se na nebo si pusťte návody na . Vývojáři, kteří chtějí plnou kontrolu, mohou GitHub repozitáře samozřejmě použít — ale jen s postupy proti blokaci a údržbovými návyky popsanými v tomhle průvodci.

Časté dotazy

Je legální scrapovat produktová data z Amazonu pomocí GitHub scraperu?

Podmínky používání Amazonu omezují automatizované sbírání dat a Amazon tato pravidla aktivně vymáhá pomocí výzev k ukončení činnosti i technických protiopatření (zejména v letech 2025–2026). Scrapování veřejně dostupných produktových dat je šedá zóna; scrapování za přihlášením nebo maskování bota jako skutečného prohlížeče nese vyšší riziko. Tohle není právní rada — pro konkrétní use case se poraďte s právním týmem.

Jak často se Amazon scraper GitHub repozitáře rozbíjejí?

Často. Amazon pravidelně mění rozložení stránek, přidává nové anti-bot vrstvy a ruší endpointy. V auditu pro tenhle článek fungovaly v roce 2026 jasně jen asi 3 z 8 široce viditelných repozitářů. I „funkční“ repa mají často otevřené issues o CAPTCHA a chybách 503. Počítejte s tím, že budete každých pár týdnů až měsíců ladit nebo aktualizovat nastavení.

Který Amazon scraper na GitHubu je v roce 2026 nejlepší?

Neexistuje jediný vítěz — záleží na vašem use case a technickém komfortu. Pro lehký, přímý Python scraper patří mezi aktuálnější možnosti. Pro širší pokrytí přes spravované API funguje , ale není to skutečné DIY. Před rozhodnutím si na jakékoli repo aplikujte checklist čerstvosti z tohoto článku.

Umí Thunderbit scrapovat Amazon bez kódování?

Ano. v Thunderbit vytáhne název produktu, cenu, ASIN, hodnocení, značku, dostupnost a další údaje jedním kliknutím. Podporuje režim scrapování v prohlížeči pro stránky vyžadující přihlášení, cloud scraping pro veřejné stránky ve vysoké rychlosti, plánované scrapování pro opakované úlohy a bezplatný export do Google Sheets, Airtable, Notion a Excelu. Začít můžete instalací .

Jak se vyhnout zablokování IP při scrapování Amazonu?

Použijte vícvrstvý přístup: (1) přejděte z prostého requests na klienta s TLS impersonací, jako je curl_cffi, (2) používejte residential proxy se sticky relacemi místo náhodné rotace datacentrových proxy, (3) přidejte náhodné tempo a exponenciální backoff, (4) držte celou sadu hlaviček v souladu s profilem prohlížeče a lokalitou tržiště a (5) opakované CAPTCHA berte jako signál k ukončení relace, ne jako hádanku, kterou je třeba řešit donekonečna. Více detailů najdete v rozhodovací matici proti blokaci výše v článku.